Microsoft 365 Copilot’ta Gizli E-postaların Özetlenmesine Neden Olan Hata Düzeltildi

Microsoft 365 Copilot‘ta Veri Güvenliği Açığı Giderildi

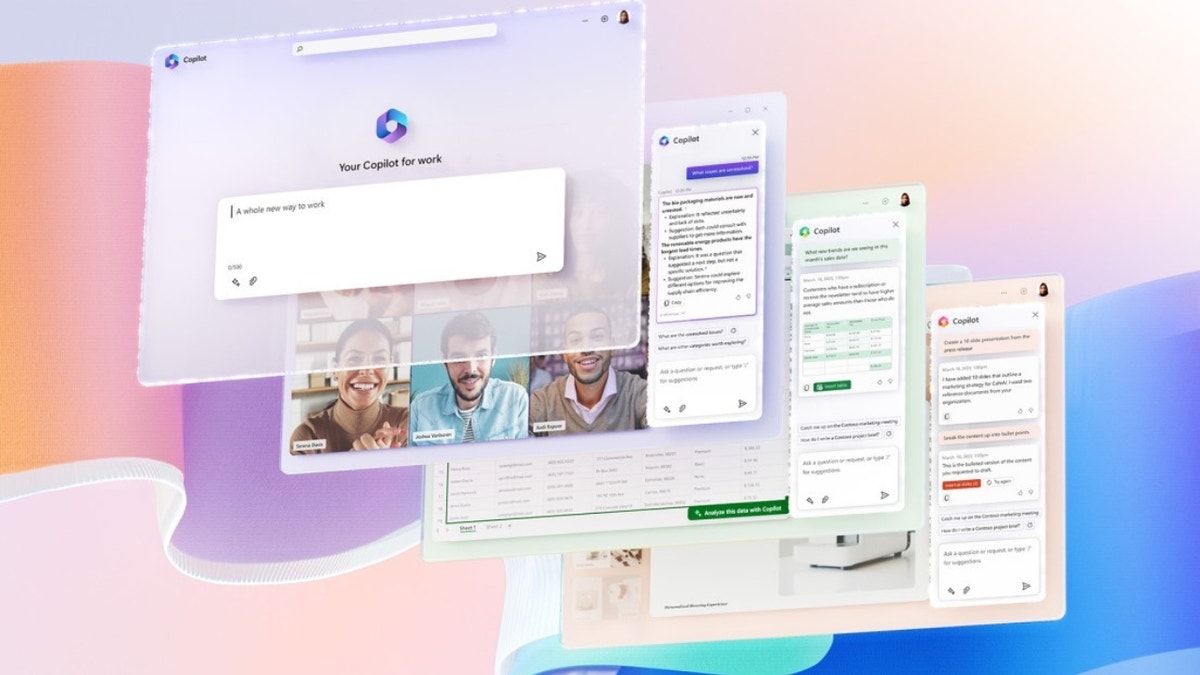

Microsoft, yapay zeka destekli üretkenlik asistanı Microsoft 365 Copilot’ta gizli e-postaların özetlenmesine neden olan bir hatayı giderdiğini duyurdu. Hata, bazı kuruluşların hassas bilgileri korumak için kullandığı veri kaybını önleme (DLP) politikalarını atlayarak ortaya çıkmıştı.

Hatanın Detayları ve Etkisi

Ocak ayının sonlarından beri devam eden bu sorun, Copilot Chat’in “çalışma” sekmesinde yaşandı. Bir kodlama hatası nedeniyle, asistan bazı kullanıcıların taslak ve gönderilmiş öğeler klasörlerindeki gizli etiketli e-postaları okuyup özetleyebiliyordu. Microsoft’a göre bu durum, kullanıcıların zaten yetkili oldukları bilgilere erişim sağlamadı; ancak şirketin amaçladığı Copilot deneyimiyle örtüşmüyordu.

Microsoft’un Açıklaması

Microsoft tarafından yapılan açıklamada, “Microsoft 365 Copilot Chat’in, kullanıcı tarafından yazılan ve taslak veya gönderilmiş öğeler klasörlerinde saklanan gizli etiketli e-postaların içeriğini döndürebileceği bir sorun tespit ettik. Bu durum, erişim kontrollerimiz ve veri koruma politikalarımız sağlam kalsa da, amaçladığımız Copilot deneyimiyle örtüşmüyordu” denildi.

Düzeltme Süreci

Şirket, Şubat ayının başlarında dünya çapındaki kurumsal müşteriler için bir yapılandırma güncellemesi dağıttığını belirtti. Ayrıca, sorunun etkilenen organizasyonların sayısını açıklamadı ve bazı kullanıcılarla iletişime geçerek düzeltmenin çalıştığını doğruluyor.

Uzman Yorumları ve Riskler

Siber güvenlik uzmanlarına göre bu olay, yapay zeka araçlarının veriye derin erişim gerektirmesi nedeniyle ortaya çıkan riskleri göz önünde bulundurmanın önemini vurguluyor. Hassas bilgilerin beklenmedik şekillerde hareket etmesi, yasal müzakerelerin yetkisiz özetlenmesi, finansal projeksiyonların kısıtlamalara rağmen işlenmesi veya insan kaynakları iletişimlerinin otomatik analizlere maruz kalması gibi durumlar ortaya çıkabilir.

Kullanıcılar İçin Öneriler

Microsoft 365 Copilot kullanıcalarına yönelik olarak aşağıdaki önlemler öneriliyor:

- Organizasyonunuzun güvenlik politikalarını gözden geçirin.

- Yapay zeka araçlarının veri erişim yetkilerini dikkatlice değerlendirin.

- Copilot’un hassas bilgileri nasıl işlediğini anlamak için ek eğitimler alın.

- Microsoft’un yayınladığı güvenlik uyarılarını takip edin ve güncellemeleri düzenli olarak uygulayın.

Sonuç

Microsoft 365 Copilot’taki bu hata, yapay zeka teknolojilerinin hızla entegre edildiği bir ortamda veri güvenliği konusunda dikkatli olunması gerektiğini bir kez daha gösterdi. Şirket, sorunu çözmek için hızlı hareket etse de, benzer olayların önüne geçebilmek için sürekli güvenlik önlemlerinin alınması ve kullanıcı farkındalığının artırılması büyük önem taşıyor.

Haberin Diğer Kareleri